Neural Machine Translation by Jointly Learning to Align and Translate.pdf

트랜스포머가 없었다면 조경현 교수님의 연구는 불가능했을까요? 아무 연관이 없을까요?

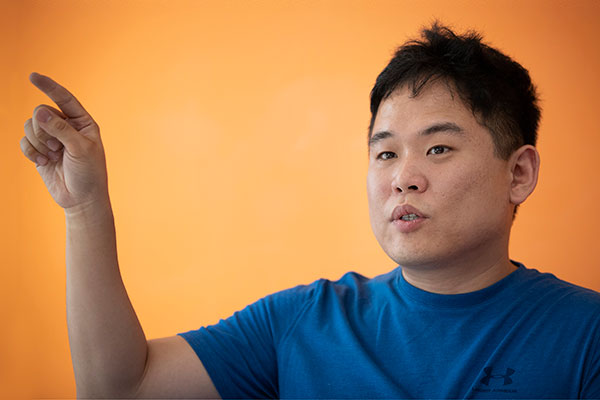

조경현 교수님은 인공지능 번역의 혁신을 가져온 GRU를 제시해 주목을 받았다고 합니다.

GRU ; Gated Recurrent Units

GRU는 LSTM의 발전된 버전으로 신경기계번역 NMT에 사용되는 핵심 기술입니다.

RNN을 개선한 모델이 LSTM이고,

LSTM의 발전된 버전이 바로 조경현 교수님의 GRU입니다.

조경현 교수님의 논문 <통계적 기계번역을 위한 인코더-디코더를 사용한 구문 표현 학습> 2014년 발표.

Learning Phrase Representations using RNN Encoder-Decoder for Statistical Machine TranslationLearning Phrase Representations using RNN Encoder-Decoder for Statistical Machine Translation.pdf

조경현 교수와 요슈아 벤지오, 그리고 바다나우 Dzmitry Bahdanau는 GRU 기술을 이용해 신경기계번역 NMT을 만들었습니다. 단어 하나하나를 따로 번역하는 것이 아닌 문장의 전체 맥락을 파악한 후에 번역하는 기술로 기계번역이지만 사람이 직접 번역한 듯 자연스럽게 번역할 수 있다는 장점이 있습니다.

NMT가 나타난 이후 구글과 네이버 등 대다수 번역엔진은 기존의 통계적 기계번역(SMT: Statistical Machine Translation)에서 NMT로 전환되었습니다. 조경현 교수가 인공지능 번역과 관련된 산업계를 전부 바꿔버린 겁니다.

이 업적으로 조경현 교수는 2018년 미국 블룸버그 통신이 선정한 50개분야에서 주목해야 할 인물로 선정되었고,

2020년 삼성AI연구자상을 받았습니다. 2021년에는 삼성호암상도 받았습니다.

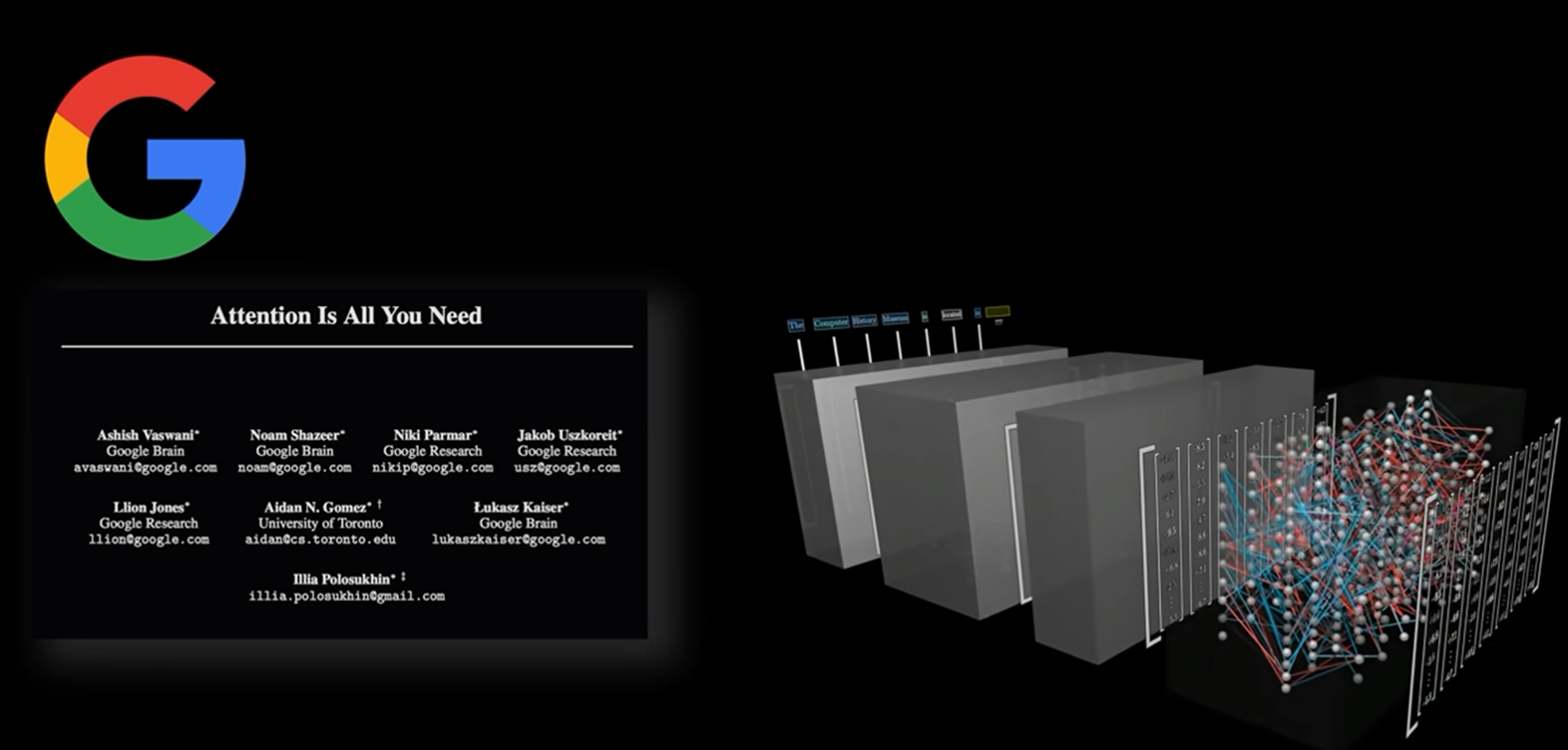

요슈아 벤지오 교수와는 논문 ‘Neural Machine Translation by Jointly Learning to Align and Translate’를 같이 쓰고 2014년에 발표하였다. 이 논문에서 신경기계번역(Neural Machine Translation, NMT) 개념이 탄생했다. 이후 인공지능 번역의 혁신은 이 논문에 뿌리를 뒀다.

comment